英雄联盟投注博彩平台赔率_实战!聊聊如何处治MySQL深分页问题

发布日期:2023-10-30 08:16 点击次数:205

全国好,我是捡田螺的小男孩。(求个星标置顶)

咱们日常作念分页需求时,一般会用limit已毕,关联词当偏移量相称大的本事,查询遵守就变得低下。本文将分四个有考虑,盘考如何优化MySQL百万数据的深分页问题,并附上最近优化坐褥慢SQL的实战案例。

皇冠hg86a

先看下表结构哈:

CREATE TABLE account ( id int(11) NOT NULL AUTO_INCREMENT COMMENT '主键Id', name varchar(255) DEFAULT NULL COMMENT '账户名', balance int(11) DEFAULT NULL COMMENT '余额', create_time datetime NOT NULL COMMENT '创建本事', update_time datetime NOT NULL ON UPDATE CURRENT_TIMESTAMP COMMENT '更新本事', PRIMARY KEY (id), KEY idx_name (name), KEY idx_update_time (update_time) //索引 ) ENGINE=InnoDB AUTO_INCREMENT=1570068 DEFAULT CHARSET=utf8 ROW_FORMAT=REDUNDANT COMMENT='账户表';

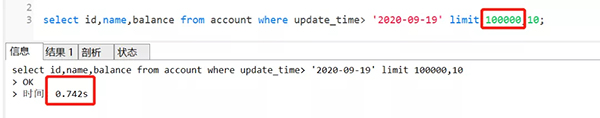

假定深分页的实践SQL如下:

select id,name,balance from account where update_time> '2020-09-19' limit 100000,10;

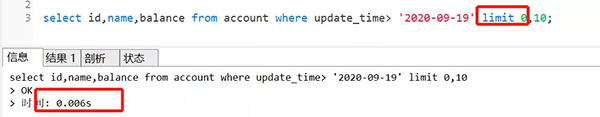

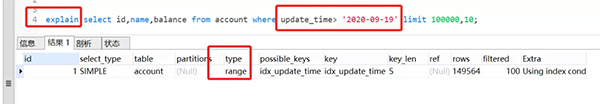

这个SQL的实践本事如下:

实践完需要0.742秒,深分页为什么会变慢呢?如若换成 limit 0,10,只需要0.006秒哦!

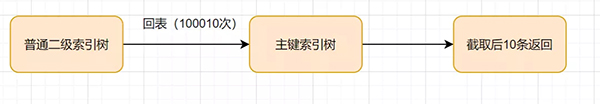

咱们先来看下这个SQL的实践经过:

通过昔日二级索引树idx_update_time,过滤update_time要求,找到知足要求的纪录ID。 通过ID,回到主键索引树,找到知足纪录的行,然后取出展示的列(回表)。 扫描知足要求的100010行,然后扔掉前100000行,复返。

SQL的实践经过

实践狡计如下:

带着疑问翻阅《Cell》期刊,美哈佛一项研究,不仅证实熬夜减寿50%,同时找出了“防猝死”的背后机制。

因为以上的SQL,回表了100010次,施行上,咱们只需要10条数据,也等于咱们只需要10次回表其实就够了。因此,咱们可以通过减少回表次数来优化。

皇冠客服飞机:@seo3687

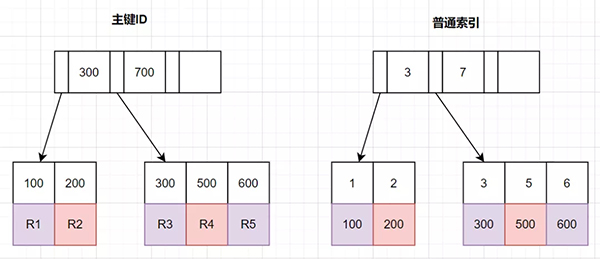

转头B+ 树结构那么,如何减少回表次数呢?咱们先来温习下B+树索引结构哈!

欧博AllbetInnoDB中,索引分主键索引(聚簇索引)和二级索引

主键索引,叶子节点存放的是整行数据。 二级索引,叶子节点存放的是主键的值。

如若咱们把查询要求,滚动回到主键索引树,那就可以减少回表次数啦。滚动到主键索引树查询的话,查询要求得改为主键id了,之前SQL的update_time这些要求咋办呢?抽到子查询那里嘛~

子查询那里如何抽的呢?因为二级索引叶子节点是有主键ID的,是以咱们径直凭证update_time来查主键ID即可,同期咱们把 limit 100000的要求,也滚动到子查询,好意思满SQL如下:

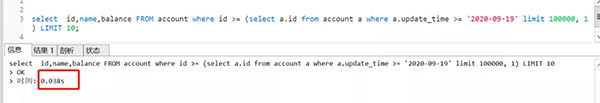

select id,name,balance FROM account where id >= (select a.id from account a where a.update_time >= '2020-09-19' limit 100000, 1) LIMIT 10;写漏了,可以补下本事要求在外面

查询遵守雷同的,欧博开户官网实践本事只需要0.038秒!

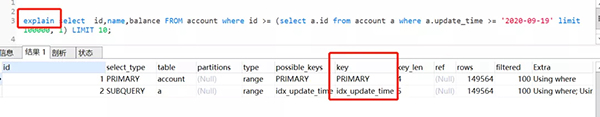

咱们来看下实践狡计:

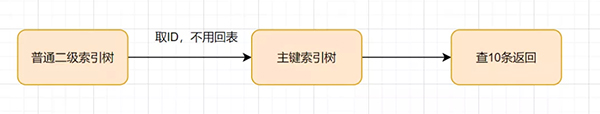

由实践狡计得知,子查询 table a查询是用到了idx_update_time索引。最初在索引上拿到了聚会索引的主键ID,省去了回表操作,然后第二查询径直凭证第一个查询的 ID往后再去查10个就可以了!

因此,这个有考虑是可以的。

INNER JOIN 蔓延联系蔓延联系的优化想路,跟子查询的优化想路其实是雷同的:王人是把要求滚动到主键索引树,然后减少回表。不同点是,蔓延联系使用了inner join代替子查询。

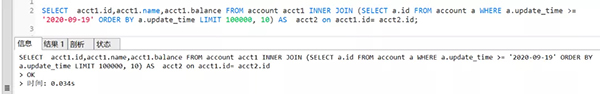

优化后的SQL如下:

SELECT acct1.id,acct1.name,acct1.balance FROM account acct1 INNER JOIN (SELECT a.id FROM account a WHERE a.update_time >= '2020-09-19' ORDER BY a.update_time LIMIT 100000, 10) AS acct2 on acct1.id= acct2.id;

查询遵守亦然杠杆的,只需要0.034秒。

赌神

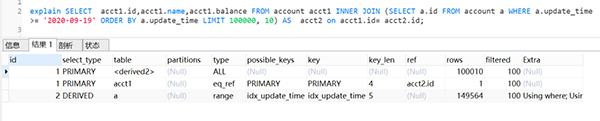

实践狡计如下:

查询想路等于,先通过idx_update_time二级索引树查询到知足要求的主键ID,再与原表通过主键ID内相连,这样背面径直走了主键索引了,同期也减少了回表。

标签纪录法limit 深分页问题的施行原因等于:偏移量(offset)越大,mysql就会扫描越多的行,然后再消除掉。这样就导致查询性能的下落。

其实咱们可以接管标签纪录法,等于象征一下前次查询到哪一条了,下次再来查的本事,从该条运行往下扫描。就大致看书雷同,前次看到那里了,你就折叠一下或者夹个书签,下次来看的本事,径直就翻到啦。

假定上一次纪录到100000,则SQL可以修改为:

select id,name,balance FROM account where id > 100000 order by id limit 10;

这样的话,背面无论翻若干页,性能王人会可以的,因为射中了id索引。关联词这种状貌有局限性:需要一种肖似一语气自增的字段。

使用between...and...好多本事,可以将limit查询调节为已知位置的查询,这样MySQL通过规模扫描between...and,就能取得到对应的甘休。

如若知谈范畴值为100000,100010后,就可以这样优化:

select id,name,balance FROM account where id between 100000 and 100010 order by id;手把手实战案例

咱们全部来看一个实战案例哈。假定当今有表结构如下,况且有200万数据.

CREATE TABLE account ( id varchar(32) COLLATE utf8_bin NOT NULL COMMENT '主键', account_no varchar(64) COLLATE utf8_bin NOT NULL DEFAULT '' COMMENT '账号' amount decimal(20,2) DEFAULT NULL COMMENT '金额' type varchar(10) COLLATE utf8_bin DEFAULT NULL COMMENT '类型A,B' create_time datetime DEFAULT NULL COMMENT '创建本事', update_time datetime DEFAULT NULL COMMENT '更新本事', PRIMARY KEY (id), KEY `idx_account_no` (account_no), KEY `idx_create_time` (create_time) ) ENGINE=InnoDB DEFAULT CHARSET=utf8 COLLATE=utf8_bin COMMENT='账户表'

业务需求是这样:获取最2021年的A类型账户数据,上报到大数据平台。

博彩平台赔率 一般想路的已毕状貌好多伙伴接到这样一个需求,会径直这样已毕了:

//查询上报总和量 Integer total = accountDAO.countAccount(); //查询上报总和量对应的SQL <select id ='countAccount' resultType="java.lang.Integer"> seelct count(1) from account where create_time >='2021-01-01 00:00:00' and type ='A' </select> //狡计页数 int pageNo = total % pageSize == 0 ? total / pageSize : (total / pageSize + 1); //分页查询,上报 for(int i = 0; i < pageNo; i++){ List<AcctountPO> list = accountDAO.listAccountByPage(startRow,pageSize); startRow = (pageNo-1)*pageSize; //上报大数据 postBigData(list); } //分页查询SQL(可能存在limit深分页问题,因为account表数据量几百万) <select id ='listAccountByPage' > seelct * from account where create_time >='2021-01-01 00:00:00' and type ='A' limit #{startRow},#{pageSize} </select>

实战优化有考虑

以上的已毕有考虑,会存在limit深分页问题,因为account表数据量几百万。那如何优化呢?

其实可以使用标签纪录法,有些伙伴可能会有疑忌,id主键不是一语气的呀,确切可以使用标签纪录?

虽然可以,id不是一语气,咱们可以通过order by让它一语气嘛。优化有考虑如下:

//查询最小ID String lastId = accountDAO.queryMinId(); //查询最小ID对应的SQL <select id="queryMinId" returnType=“java.lang.String”> select MIN(id) from account where create_time >='2021-01-01 00:00:00' and type ='A' </select> //一页的条数 Integer pageSize = 100; List<AcctountPO> list ; do{ list = listAccountByPage(lastId,pageSize); //标签纪录法,纪录前次查询过的Id lastId = list.get(list,size()-1).getId(); //上报大数据 postBigData(list); }while(CollectionUtils.isNotEmpty(list)); <select id ="listAccountByPage"> select * from account where create_time >='2021-01-01 00:00:00' and id > #{lastId} and type ='A' order by id asc limit #{pageSize} </select>

上一篇:没有了 下一篇:亚星轮盘博彩平台游戏技巧_苏联【反攻之战】国语